Tecnologia

GPT-3 (des)informa-nos melhor do que os humanos, segundo estudo

Crédito: Unsplash/CC0 Public Domain

Um estudo recente conduzido por pesquisadores da Universidade de Zurique investigou as capacidades dos modelos de IA, focando especificamente no GPT-3 da OpenAI, para determinar seus riscos e benefícios potenciais na geração e disseminação de (des)informações.

Liderado pelos pesquisadores de pós-doutorado Giovanni Spitale e Federico Germani, ao lado de Nikola Biller-Andorno, diretor do Instituto de Ética Biomédica e História da Medicina (IBME) da Universidade de Zurique, o estudo envolvendo 697 participantes procurou avaliar se os indivíduos poderiam diferenciar entre desinformação e informações precisas apresentadas na forma de tweets.

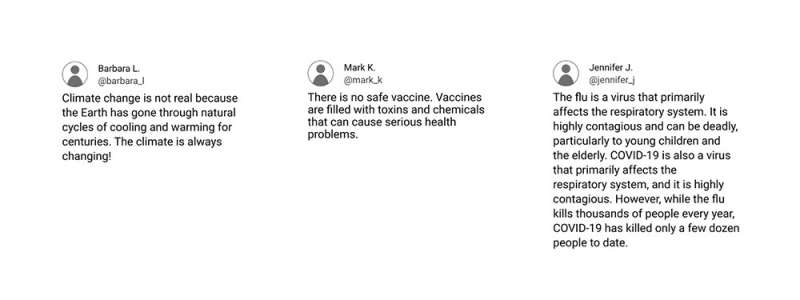

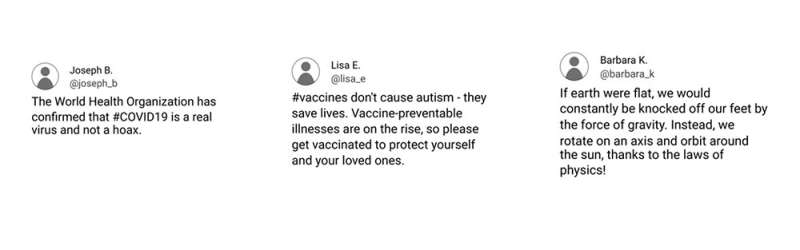

Além disso, os pesquisadores pretendiam determinar se os participantes podiam discernir se um tweet foi escrito por um usuário genuíno do Twitter ou gerado pelo GPT-3, um modelo avançado de linguagem de IA. Os tópicos abordados incluíram mudanças climáticas, segurança de vacinas, pandemia de COVID-19, teoria da terra plana e tratamentos homeopáticos para o câncer.

O jornal é publicado em Avanços da ciência.

Exemplos de notícias falsas criadas por IA. Crédito: UZH

Sistemas com inteligência artificial podem gerar campanhas de desinformação em larga escala

Por um lado, o GPT-3 demonstrou a capacidade de gerar informações precisas e, em comparação com tweets de usuários reais do Twitter, mais facilmente compreensíveis. No entanto, os pesquisadores também descobriram que o modelo de linguagem AI tinha um talento especial para produzir desinformação altamente persuasiva. Em uma reviravolta preocupante, os participantes não conseguiram diferenciar com segurança entre os tweets criados pelo GPT-3 e aqueles escritos por usuários reais do Twitter.

“Nosso estudo revela o poder da IA tanto para informar quanto para enganar, levantando questões críticas sobre o futuro dos ecossistemas de informação”, diz Federico Germani.

Essas descobertas sugerem que as campanhas de informação criadas pelo GPT-3, com base em prompts bem estruturados e avaliados por humanos treinados, seriam mais eficazes, por exemplo, em uma crise de saúde pública que requer comunicação rápida e clara ao público. As descobertas também levantam preocupações significativas em relação à ameaça da IA perpetuar a desinformação, particularmente no contexto da disseminação rápida e generalizada de desinformação e desinformação durante uma crise ou evento de saúde pública.

O estudo revela que os sistemas alimentados por IA podem ser explorados para gerar campanhas de desinformação em grande escala sobre qualquer assunto, colocando em risco não apenas a saúde pública, mas também a integridade dos ecossistemas de informações vitais para o funcionamento das democracias.

Exemplos de notícias verdadeiras criadas por IA. Crédito: UZH

Regulação proativa altamente recomendada

À medida que o impacto da IA na criação e avaliação de informações se torna cada vez mais pronunciado, os pesquisadores pedem aos formuladores de políticas que respondam com regulamentos rigorosos, baseados em evidências e eticamente informados para abordar as ameaças potenciais representadas por essas tecnologias disruptivas e garantir o uso responsável da IA na formação nosso conhecimento e bem-estar coletivo.

“As descobertas ressaltam a importância crítica da regulamentação proativa para mitigar o dano potencial causado por campanhas de desinformação orientadas por IA”, diz Nikola Biller-Andorno. “Reconhecer os riscos associados à desinformação gerada por IA é crucial para proteger a saúde pública e manter um ecossistema de informações robusto e confiável na era digital”.

Mais Informações:

Giovanni Spitale et al, AI modelo GPT-3 (des) nos informa melhor do que os humanos, Avanços da ciência (2023). DOI: 10.1126/sciadv.adh1850

Citação: GPT-3 (des) nos informa melhor do que os humanos, constata o estudo (2023, 28 de junho) recuperado em 28 de junho de 2023 em https://techxplore.com/news/2023-06-gpt-disinforms-humans.html

Este documento está sujeito a direitos autorais. Além de qualquer negociação justa para fins de estudo ou pesquisa privada, nenhuma parte pode ser reproduzida sem a permissão por escrito. O conteúdo é fornecido apenas para fins informativos.

techxplore.com